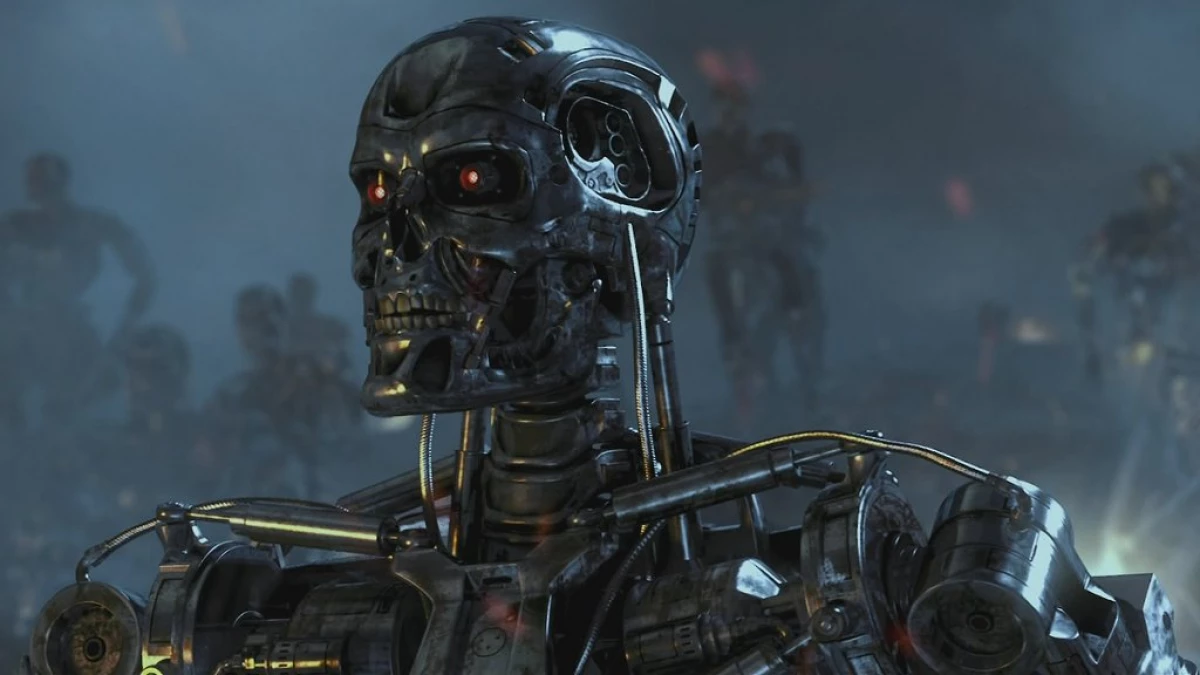

Οι εργασίες δημοσιεύονται στην Εφημερίδα της Τεχνικής Έρευνας Πληροφοριών. Ο κίνδυνος που μπορεί να προχωρήσει από τις εξαιρετικά προηγούμενες πράξεις, όπως είναι γνωστό, στα χρώματα περιγράφεται σε blockbusters σχετικά με τον τερματιστή. Εκπρόσωποι διαφόρων επιστημονικών κλάδων, συμπεριλαμβανομένων ειδικών από το Κέντρο Ατόμων και Μηχανημάτων Ινστιτούτο για την Ανάπτυξη του Man Max Planck, αποφάσισε να ελέγξει το πόσο πρόσωπο είναι σε θέση να διαχειριστεί εξαιρετικά ελαττωματικά ρομπότ.

"Μια υπερ-διακήρυξη που διαχειρίζεται τον κόσμο - ακούγεται σαν επιστημονική φαντασία. Αλλά υπάρχουν ήδη ρομπότ που εκτελούν ορισμένα σημαντικά καθήκοντα ανεξάρτητα. Ταυτόχρονα, οι προγραμματιστές δεν καταλαβαίνουν καθόλου πώς το έμαθαν. Ως αποτέλεσμα, τίθεται το ερώτημα: μπορεί αυτή τη διαδικασία σε κάποιο σημείο να γίνει ανεξέλεγκτο και επικίνδυνο για την ανθρωπότητα; " - Λέει ένας από τους συντάκτες της μελέτης του Manuel Sebarian, ο επικεφαλής της ομάδας ψηφιακών κινητοποιήσεων στο κέντρο των ανθρώπων και μηχανημάτων του Ινστιτούτου Max Plank.

Για να απαντήσετε σε αυτή την ερώτηση, οι επιστήμονες χρησιμοποίησαν μοντελοποίηση και θεωρητικούς υπολογισμούς. Όπως αποδείχθηκε, ακόμη και αν τα δεδομένα σχετικά με τις δεοντολογικές αρχές στο Overtongon Car και περιορίζουν τη σύνδεσή του με τον εξωτερικό κόσμο (για παράδειγμα, απενεργοποιήστε την πρόσβαση στο Internet), δεν θα εξοικονομήσει την ανθρωπότητα από τους κινδύνους που θα κυκλοφορήσει ένα τέτοιο σύστημα από υπό έλεγχο.

Το γεγονός είναι ότι, σύμφωνα με τη θεωρία της πληροφορικής, οποιοσδήποτε από τους αλγόριθμους μιας τέτοιας αποτροπής - είτε πρόκειται για ένα πρόγραμμα σχετικά με τις δεοντολογικές αρχές είτε να περιορίζει την πρόσβαση στον εξωτερικό κόσμο - ευάλωτη και υπό ορισμένες συνθήκες, είναι απολύτως ικανό να απενεργοποιηθεί. Ως εκ τούτου, οι ειδικοί καταλήγουν στο συμπέρασμα ότι απλά δεν θα είναι σε θέση να διαχειριστεί το σούπερ-επηρεασμένο πρόσωπο AI και την κατάσταση αργά ή γρήγορα μπορεί να ξεφύγει από τον έλεγχο.

"Υποστηρίζουμε ότι η πλήρης αποτροπή είναι καταρχήν αδύνατη λόγω των θεμελιωδών περιορισμών που είναι εγγενής στον ίδιο τον υπολογισμό. Το Superflum θα περιέχει ένα πρόγραμμα που περιλαμβάνει όλα τα προγράμματα που διεξάγονται χρησιμοποιώντας το Universal Machine Turing, δυνητικά ως σύνθετο ως το κράτος του κόσμου ", καταλήγουν οι ερευνητές.

Πηγή: Γυμνή επιστήμη