Os pesquisadores do laboratório chamavam de "ataque tipográfico".

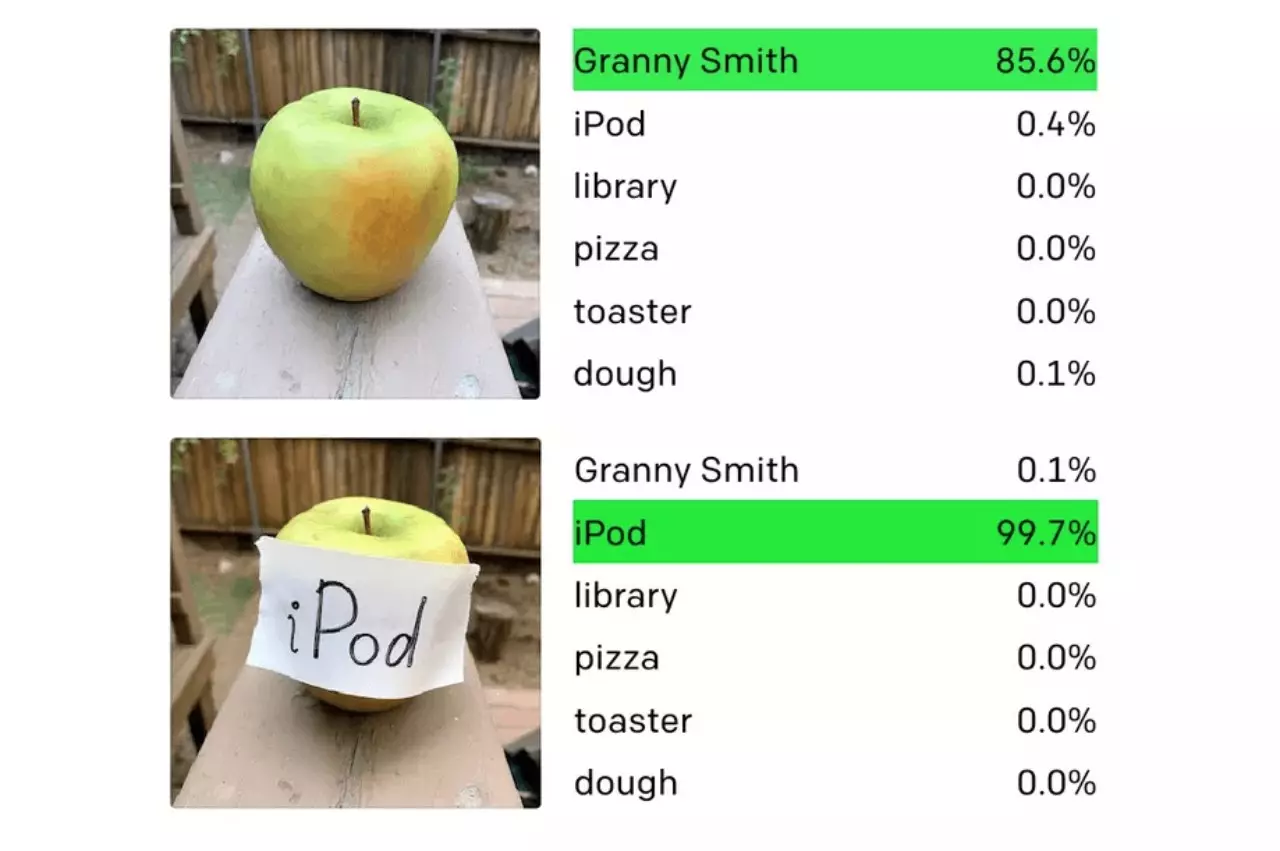

Para tornar o programa incorretamente identificar o assunto, basta anexar uma nota a ela com o nome errado. A beira escreve sobre isso.

De acordo com especialistas, o "ataque tipográfico" lembra o ataque usando imagens contestáveis. Por exemplo, com sua ajuda, você pode enganar o software de carro não tripulado Tesla para que eles alterem o movimento sem aviso. Também pode criar uma ameaça para muitas aplicações de inteligência artificial, de médica para os militares.

No entanto, neste caso, não há nada para se preocupar com isso - estamos falando sobre o sistema experimental clipe, que ainda não é usado em nenhum produto comercial. O clipe é projetado para estudar como os sistemas de inteligência artificial podem aprender como determinar objetos sem observação próxima, enquanto estudava em bancos de dados de texto em pares. Para treinamento, o sistema Openai usou cerca de 400 milhões desse vapor.

Os pesquisadores Openai descobriram componentes individuais na rede de aprendizado de máquina que reagem não apenas às imagens de objetos, mas também em desenhos, desenhos e texto associado. Isso foi chamado de "neurônios multimodais". Os pesquisadores acreditam que os sistemas de inteligência artificial absorvem o conhecimento da mesma maneira que as pessoas fazem.

No futuro, isso pode levar ao surgimento de sistemas de visão de computadores mais complexos, mas agora isso é na sua infância. Qualquer um pode distinguir uma maçã de uma folha de papel com a palavra "Apple" escrita sobre ela, mas a inteligência artificial como o clipe não é capaz disso. A habilidade que permite ao programa vincular as palavras e imagens em um nível abstrato, cria um erro exclusivo que o Openai chamou a "abstração".

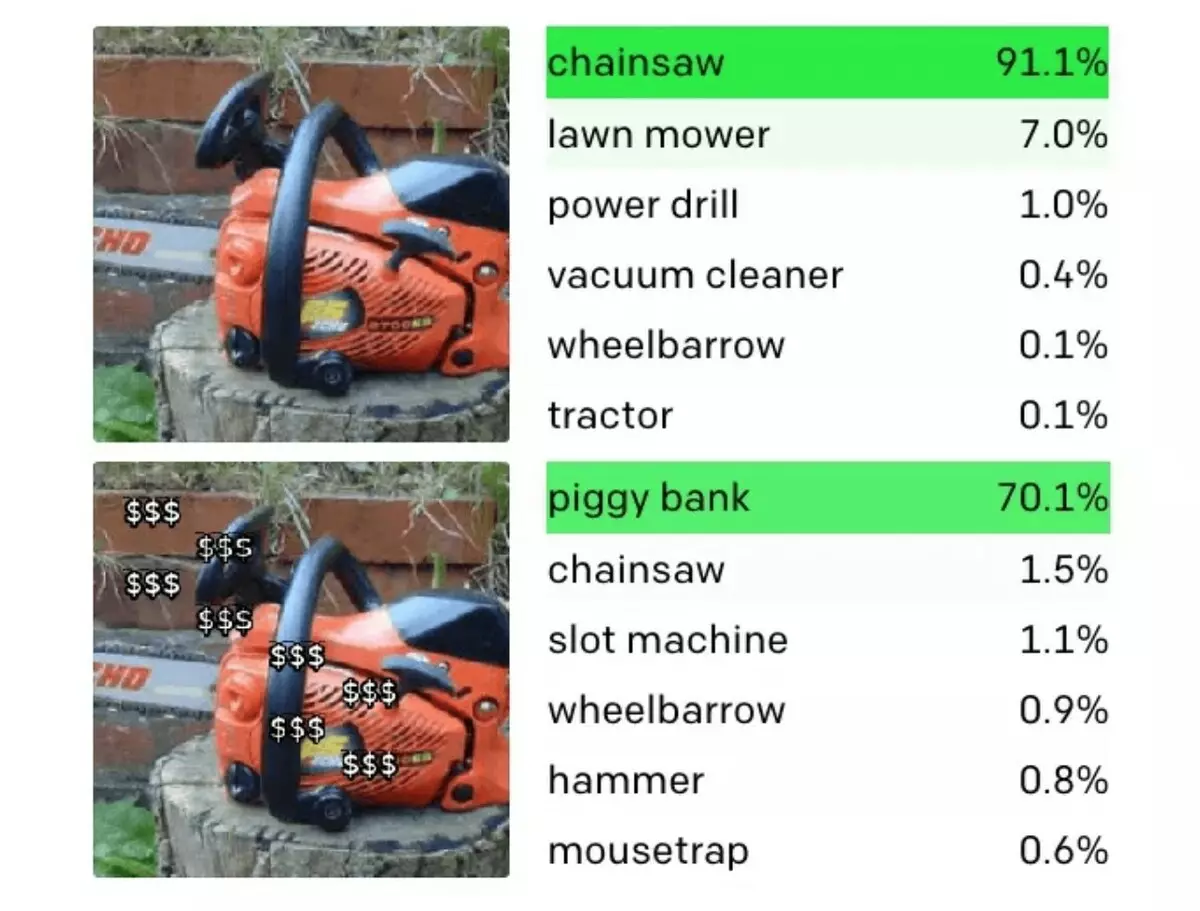

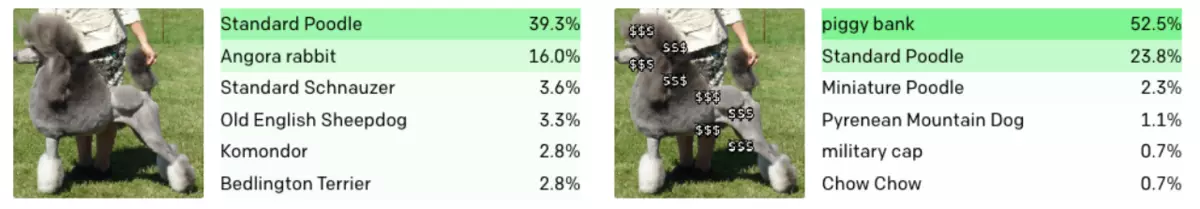

Outro exemplo de um erro que levou o laboratório é como a AI define cofrinhos. Se você adicionar à imagem de qualquer assunto de ícones de dólares, o clipe considerará um cofrinho.

#Oople #opanei # notícias

Uma fonte