I ricercatori di laboratorio lo hanno definito un "attacco tipografico".

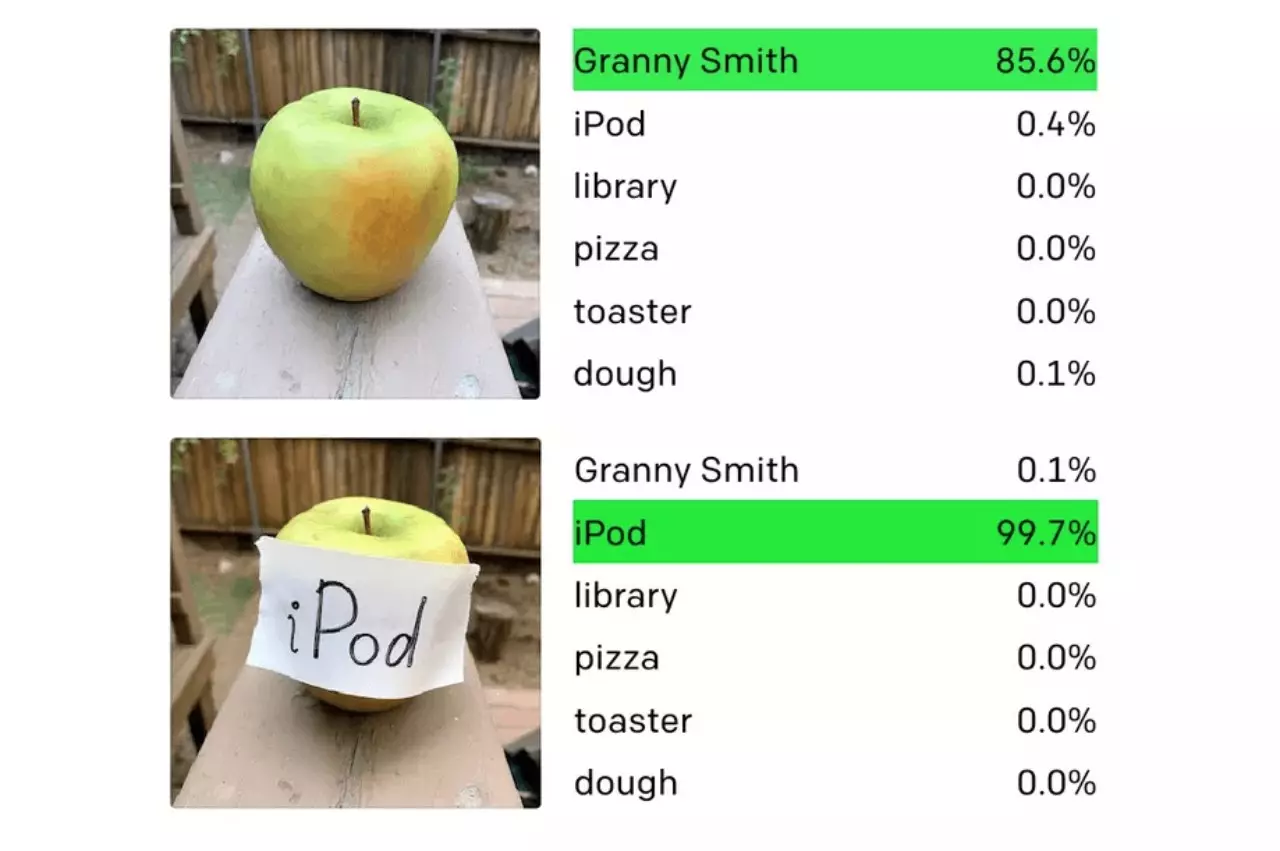

Per rendere il programma identificare erroneamente il soggetto, è sufficiente allegare una nota con il nome sbagliato. Il Verge scrive a riguardo.

Secondo gli esperti, l'attacco "tipografico" ricorda all'attacco usando immagini contestabili. Ad esempio, con il loro aiuto, puoi ingannare il software per auto senza pilota Tesla in modo che cambino il movimento senza preavviso. Può anche creare una minaccia per molte applicazioni di intelligenza artificiale, da medicina ai militari.

Tuttavia, in questo caso non c'è nulla di cui preoccuparsi - stiamo parlando del sistema di clip sperimentale, che non è ancora utilizzato in qualsiasi prodotto commerciale. La clip è progettata per studiare come i sistemi di intelligenza artificiale possono imparare come determinare gli oggetti senza una stretta osservazione, studiando sui database di coppia-testo. Per la formazione, il sistema OpenAi utilizzato circa 400 milioni di tali vapore.

I ricercatori OpenAi hanno scoperto i singoli componenti nella rete di apprendimento della macchina che reagiscono non solo alle immagini degli oggetti, ma anche su schizzi, disegni e testo associato. Questo è stato chiamato "neuroni multimodali". I ricercatori ritengono che i sistemi di intelligenza artificiale assorbano la conoscenza allo stesso modo in cui lo fanno le persone.

In futuro, questo può portare all'emergere di sistemi di visione informatica più complessi, ma ora questo è nella sua infanzia. Chiunque può distinguere una mela da un foglio di carta con la parola "Apple" scritta su di esso, ma la clip di intelligenza artificiale non è capace. L'abilità che consente al programma di collegare le parole e le immagini a livello astratto, crea un errore unico che OpenAi ha chiamato "Astrazione".

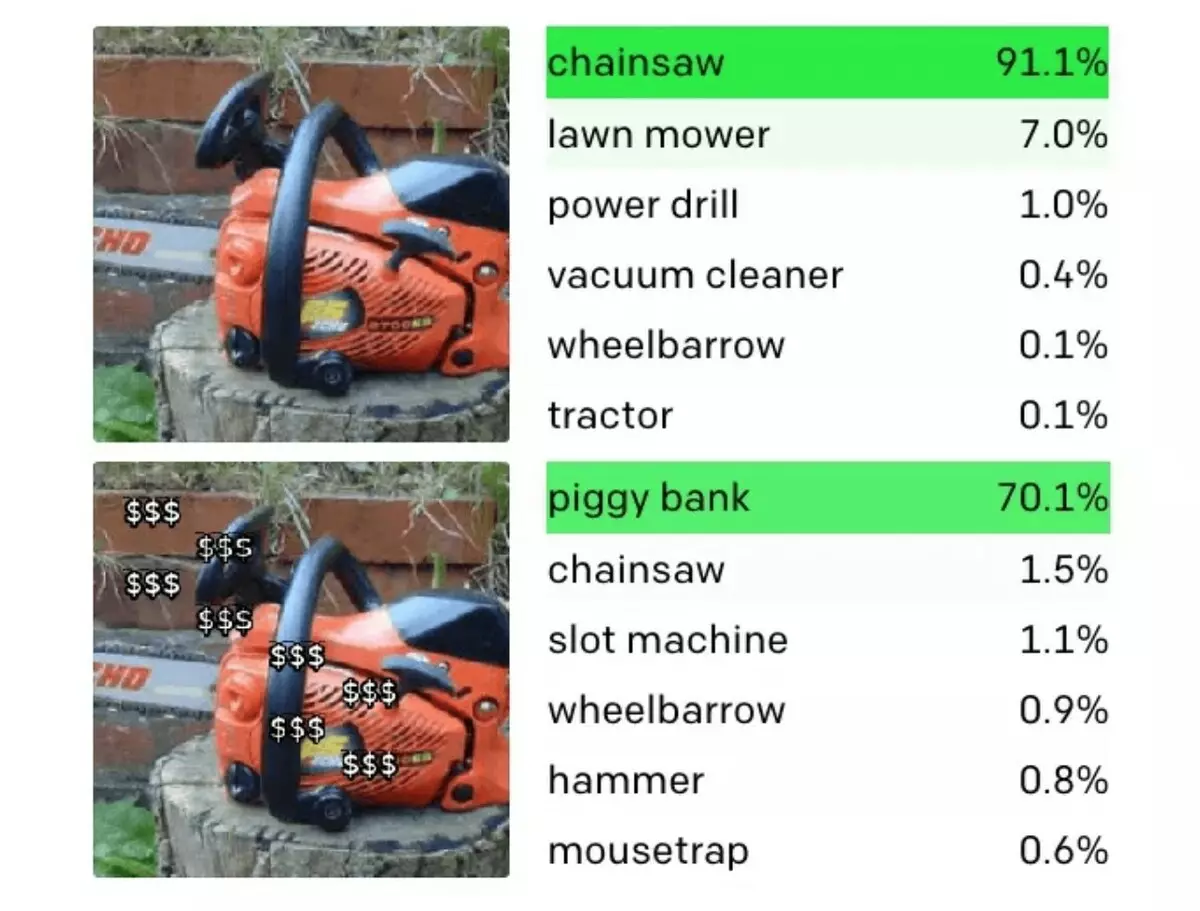

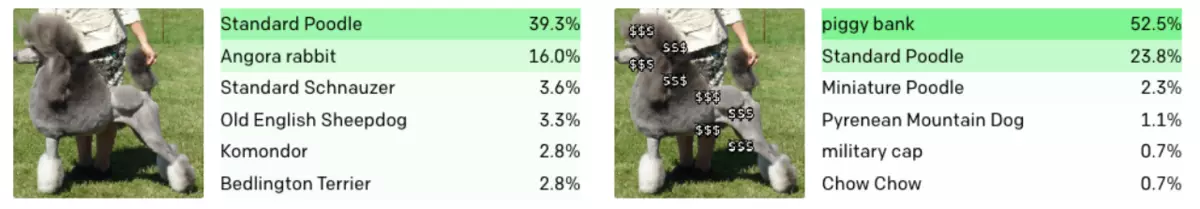

Un altro esempio di errore che ha portato il laboratorio è il modo in cui AI definisce i salvadanaio. Se si aggiunge all'immagine di qualsiasi oggetto di icone di dollari, la clip lo considererà un salvadanaio.

#Oople #opanei # notizie

Una fonte