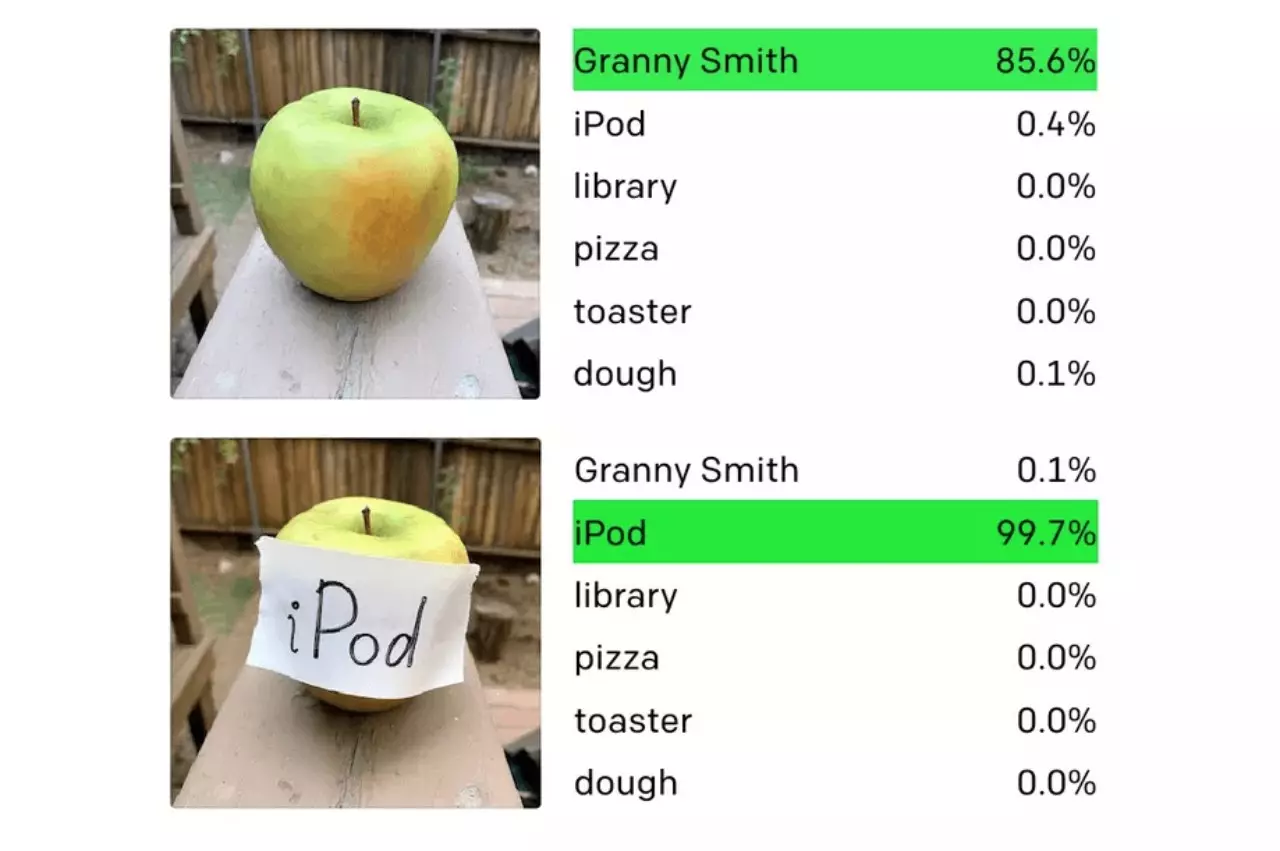

חוקרי המעבדה קראו לו "התקפה טיפוגרפית".

כדי להפוך את התוכנית לזהות באופן שגוי את הנושא, זה מספיק כדי לצרף פתק לזה עם השם הלא נכון. את Verge כותב על זה.

לדברי מומחים, "ההתקפה הטיפוגרפית" מזכירה את ההתקפה באמצעות תמונות contestable. לדוגמה, בעזרתם, אתה יכול לרמות את טסלה תוכנת רכב ללא טייס, כך שהם לשנות את התנועה ללא אזהרה. זה יכול גם ליצור איום על יישומים רבים של אינטליגנציה מלאכותית, מ רפואי לצבא.

עם זאת, במקרה זה אין מה לדאוג לגבי זה - אנחנו מדברים על מערכת קליפ ניסיוני, אשר עדיין לא נעשה שימוש בכל מוצר מסחרי. קליפ נועד ללמוד כיצד מערכות בינה מלאכותית יכולות ללמוד כיצד לקבוע אובייקטים ללא תצפית קרובה, תוך לימוד על מסדי נתונים של זוג טקסט. עבור אימון, מערכת Openai השתמשה כ 400 מיליון קיטור כזה.

חוקרים Openai גילו רכיבים בודדים ברשת הלמידה של המכונה המגיבים לא רק לתמונות של אובייקטים, אלא גם על סקיצות, ציורים וטקסט משויך. זה נקרא "נוירונים multimodal". חוקרים מאמינים כי מערכות בינה מלאכותית לספוג ידע באותו אופן כמו אנשים עושים.

בעתיד, זה יכול להוביל את הופעתה של מערכות ראיית מחשב מורכבות יותר, אבל עכשיו זה בחיתוליו. כל אחד יכול להבחין אפל מתוך גיליון נייר עם המילה "תפוח" כתוב על זה, אבל בינה מלאכותית כמו קליפ אינו מסוגל לכך. היכולת המאפשרת לתוכנית לקשר את המילים והתמונות ברמה מופשטת, יוצרת טעות ייחודית ש- Optai שנקרא "הפשטה".

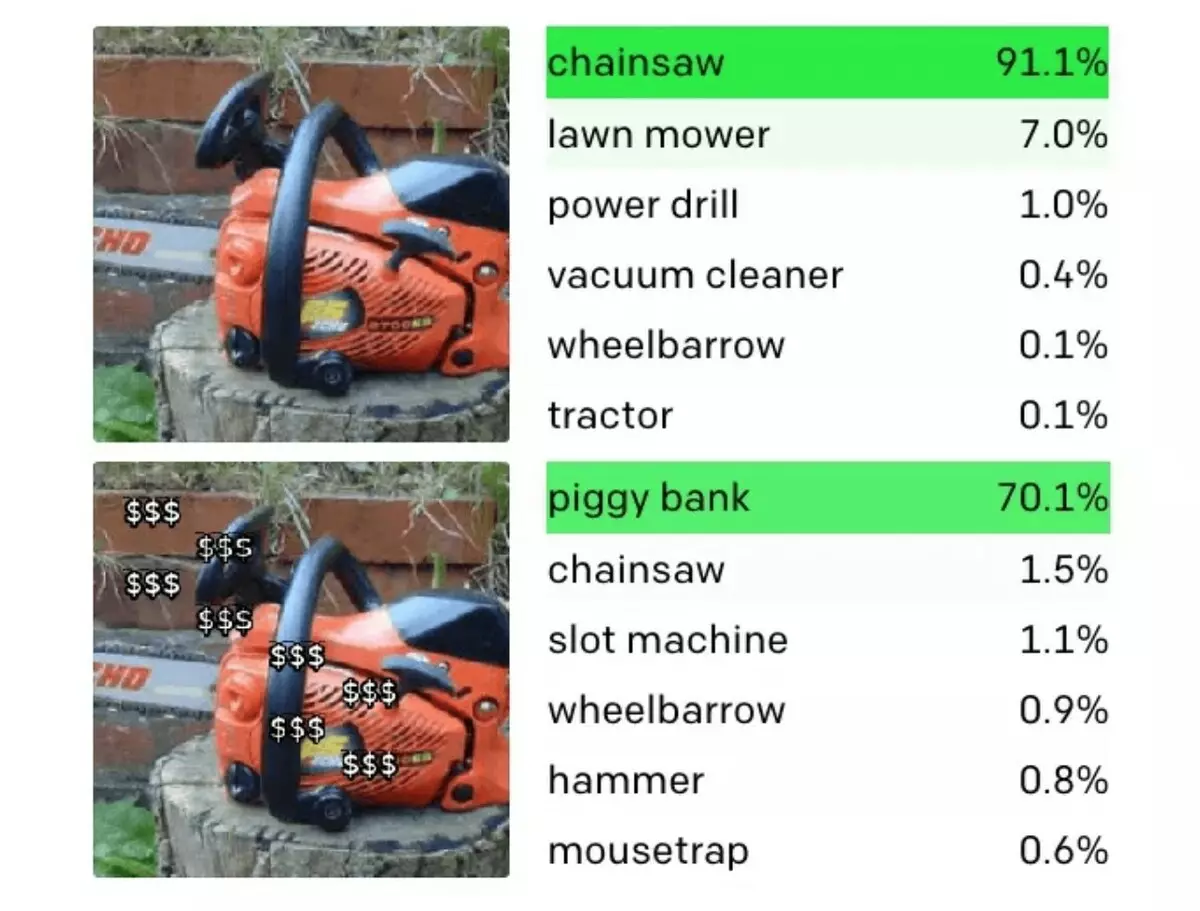

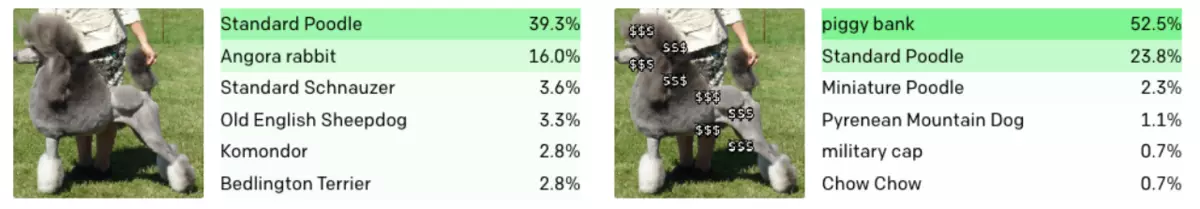

דוגמה נוספת של שגיאה שהובילה את המעבדה היא כיצד מגדירה AI בנקים פיגי. אם תוסיף את התמונה של כל נושא של דולרים סמלים, קליפ ישקול את זה בנק חזירון.

#Oople #opanei # חדשות

מקור