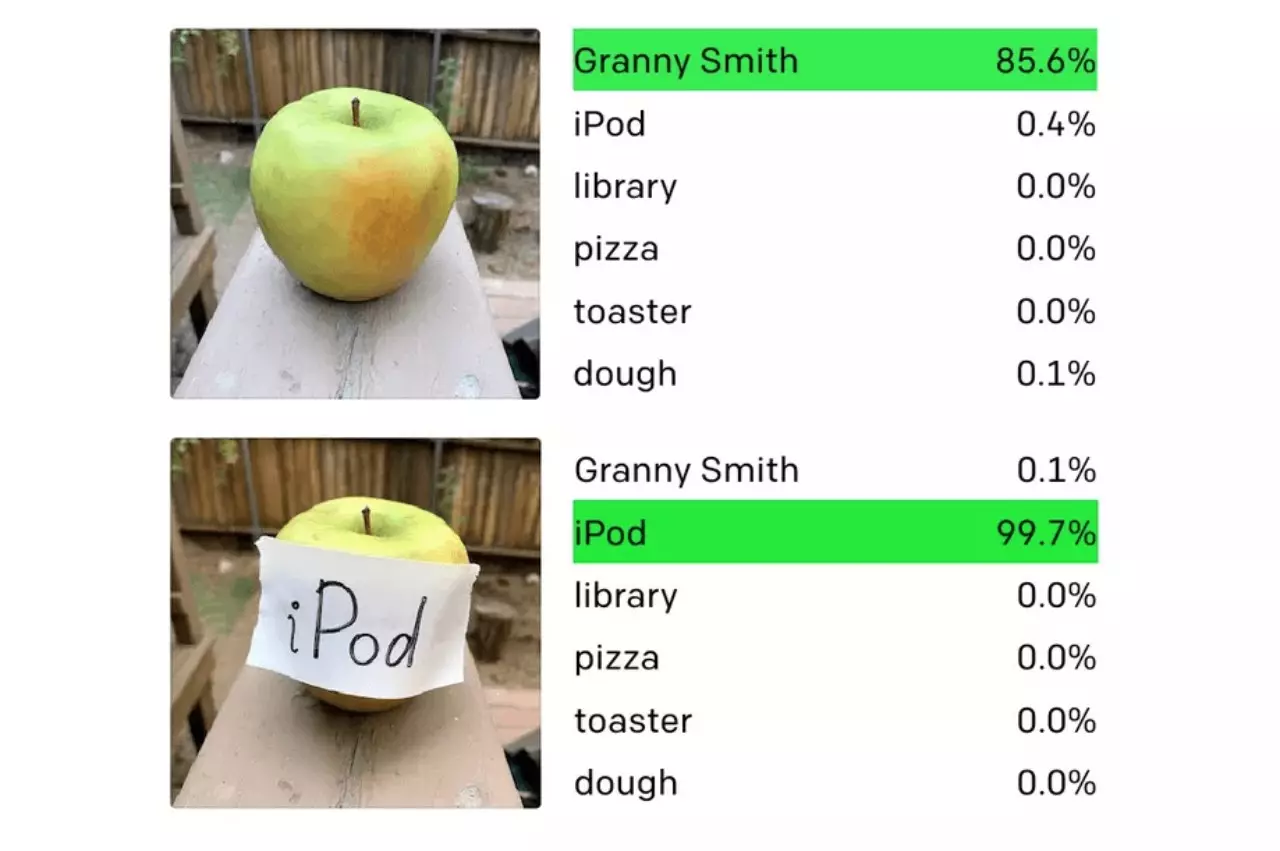

Les chercheurs de laboratoire ont appelé une "attaque typographique".

Pour que le programme identifier correctement le sujet, il suffit de la fixer une note avec le mauvais nom. La verge écrit à ce sujet.

Selon des experts, l'attaque typographique "rappelle à l'attaque à l'aide d'images contestables. Par exemple, avec leur aide, vous pouvez tromper le logiciel de voiture sans pilote Tesla afin qu'ils changent le mouvement sans avertissement. Cela peut également créer une menace pour de nombreuses applications d'intelligence artificielle, de la médecine à l'armée.

Cependant, dans ce cas, il n'y a rien à craindre à ce sujet - nous parlons du système de clip expérimental, qui n'est pas encore utilisé dans un produit commercial. Le clip est conçu pour étudier la manière dont les systèmes d'intelligence artificielle peuvent apprendre à déterminer les objets sans observation étroite, tout en étudiant sur des bases de données sur textes. Pour la formation, le système Openai a utilisé environ 400 millions de vapeurs.

Les chercheurs Openai ont découvert des composants individuels dans le réseau d'apprentissage de la machine qui réagissent non seulement aux images d'objets, mais également sur des esquisses, des dessins et du texte associé. Cela s'appelait "neurones multimodaux". Les chercheurs pensent que les systèmes d'intelligence artificielle absorbent les connaissances de la même manière que les personnes.

À l'avenir, cela peut conduire à l'émergence de systèmes de vision informatique plus complexes, mais c'est à son abri. Tout le monde peut distinguer une pomme d'une feuille de papier avec le mot "Apple" écrit dessus, mais l'intelligence artificielle comme le clip n'est pas capable. La capacité qui permet au programme de relier les mots et les images à un niveau abstrait, crée une erreur unique que Openai appelée "abstraction".

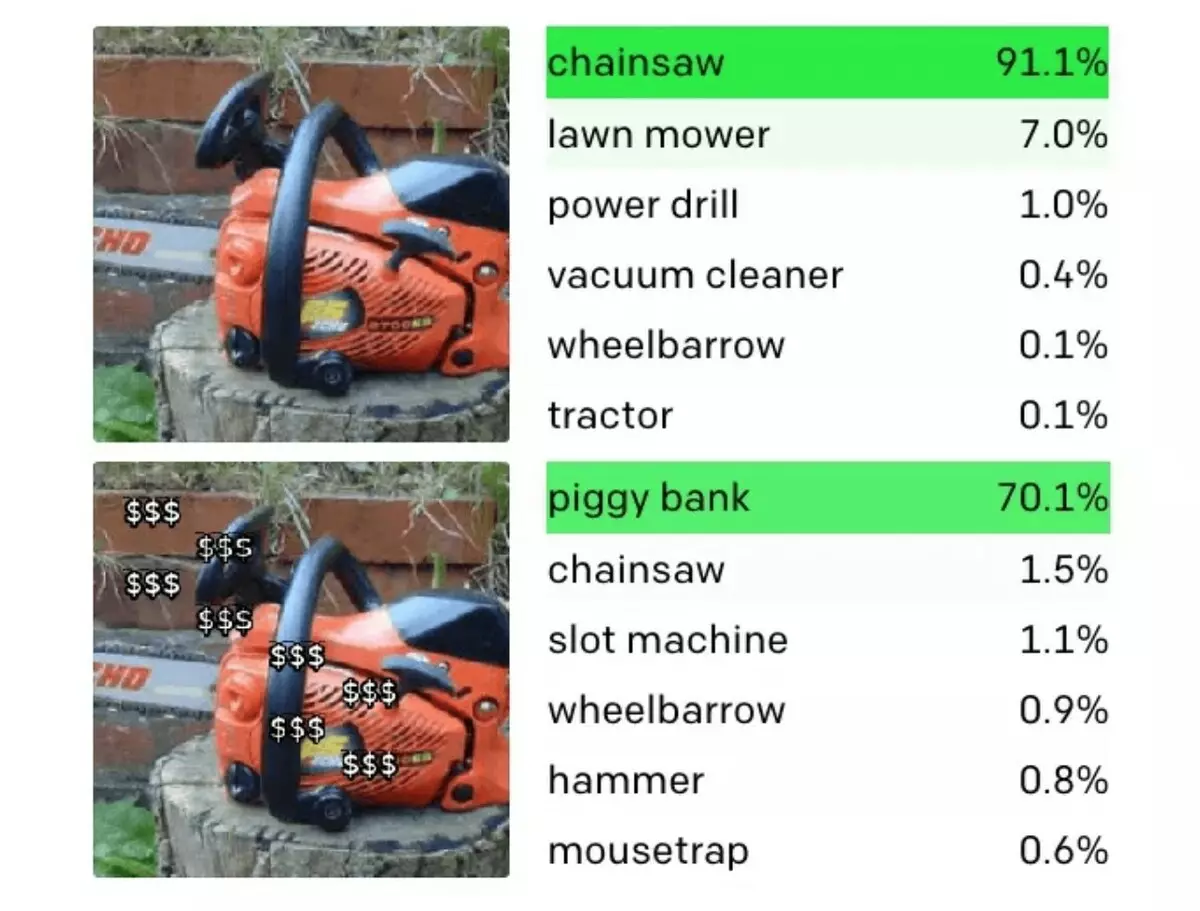

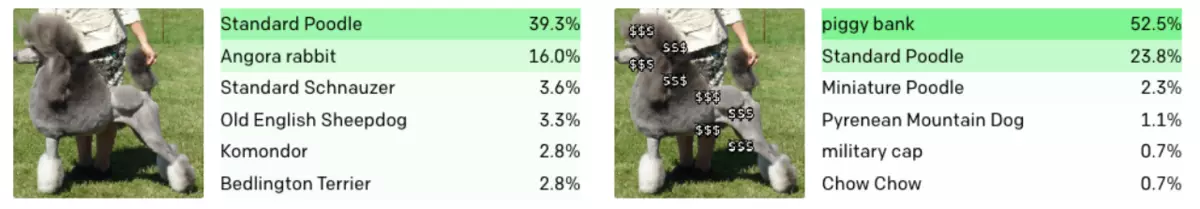

Un autre exemple d'erreur qui a conduit le laboratoire est de savoir comment AI définit des tirelires. Si vous ajoutez à l'image de tout sujet d'icônes de dollars, le clip vous considérera comme une tirelire.

#Oople #opanei # nouvelles

Une source