Laboratoriotutkijat kutsuivat sitä "typografiseksi hyökkäyksi".

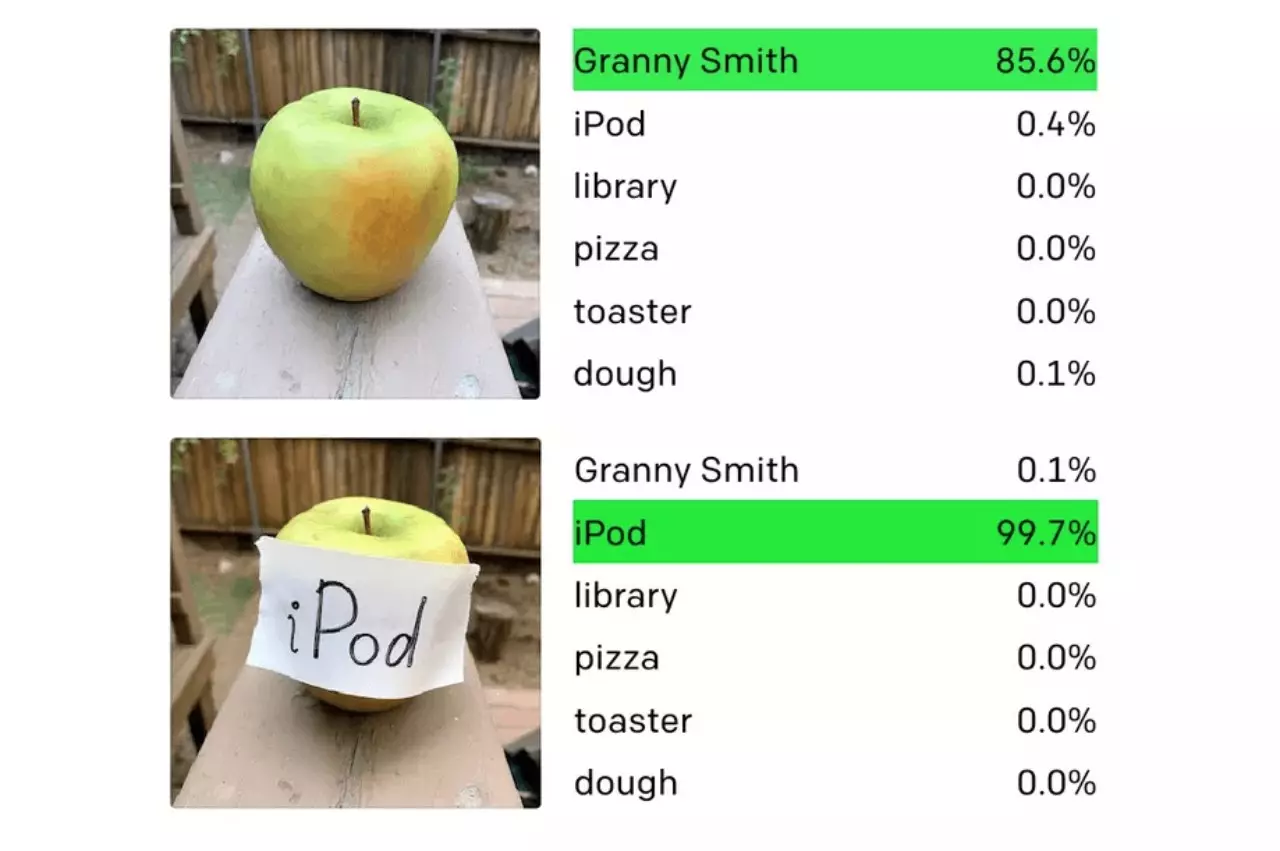

Jos ohjelma tunnistaa väärin aiheen, riittää kiinnittämään merkinnän väärällä nimellä. Verge kirjoittaa siitä.

Asiantuntijoiden mukaan "typografinen hyökkäys" muistuttaa hyökkäystä kilpailevien kuvien avulla. Esimerkiksi heidän avunsa avulla voit pettää Teslan miehittämättömän auton ohjelmiston, jotta ne muuttavat liikkumista ilman varoitusta. Se voi myös luoda monia keinotekoisen älykkyyden sovelluksia, lääketieteellisestä sotilasta.

Tässä tapauksessa ei kuitenkaan ole mitään huolta siitä - puhumme kokeellisesta leikejärjestelmästä, jota ei ole vielä käytetty kaupallisessa tuotteessa. Clip on suunniteltu tutkimaan, miten keinotekoiset tiedustelujärjestelmät voivat oppia määrittämään esineitä ilman tarkkailua, kun opiskelet pari-tekstitietokantoja. Koulutukseen OpenA: n järjestelmä käytti noin 400 miljoonaa tällaista höyryä.

Openai tutkijat ovat löytäneet yksittäisiä komponentteja koneen oppimisverkossa, joka reagoi paitsi esineiden kuviin, myös luonnoksiin, piirustuksiin ja siihen liittyviin tekstiin. Tätä kutsuttiin "multimodaalisiksi neuroneiksi". Tutkijat uskovat, että keinotekoiset tiedustelujärjestelmät absorboivat tietämystä samalla tavalla kuin ihmiset tekevät.

Tulevaisuudessa tämä voi johtaa monimutkaisempien tietokoneen visiojärjestelmien syntymiseen, mutta nyt tämä on sen alkuvaiheessa. Kuka tahansa voi erottaa omenan paperiarkista sanalla "Apple", joka on kirjoitettu siitä, mutta keinotekoinen älykkyys kuten leike ei pysty siihen. Kyky, jonka avulla ohjelma voi yhdistää sanat ja kuvat abstraktisella tasolla, luo ainutlaatuisen virheen, jonka Openai kutsutaan "abstraktio".

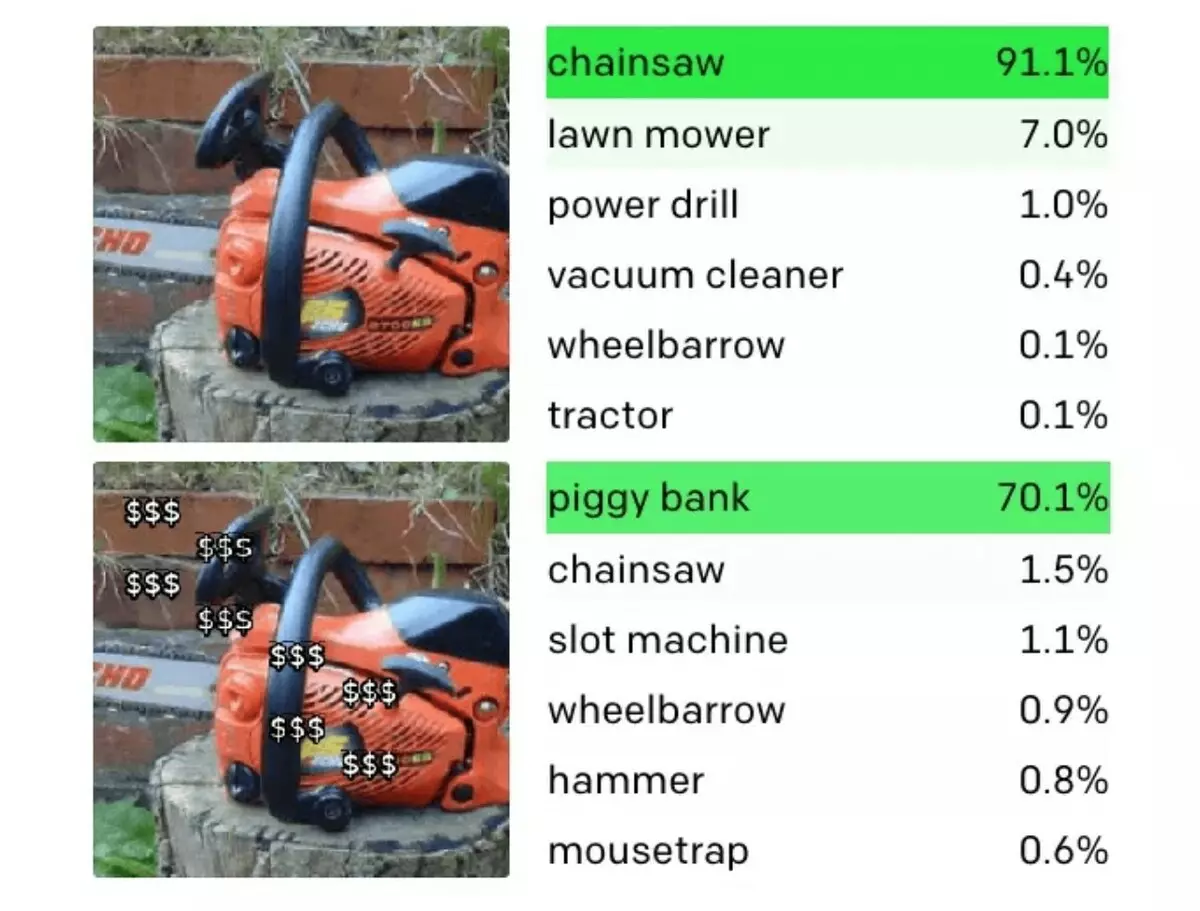

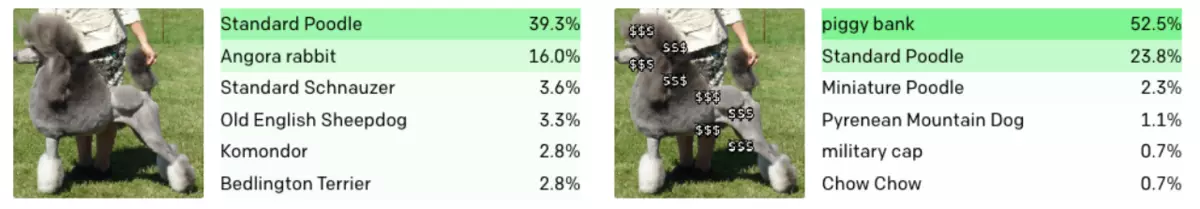

Toinen esimerkki laboratoriosta johtuvasta virheestä on, miten AI määrittelee säästöpossu. Jos lisäät Dollarsin kuvakkeiden kohteen kuva, Clip harkitsee sitä säästöpossu.

#Oople #opanei # uutiset

Lähde